Reinforcement Learning

Proximal Policy Optimization

限制策略更新的变化幅度:

裁剪 (clipping) 幅度过小或过大的部分,

这就是 近端 的含义.

Group Relative Policy Optimization

PPO 四个模型 (actor, critic, reference, reward), 需要计算成本与大量显存.

GRPO

对于同一问题 (prompt), 一次性生产一组答案,

利用平均分 (group relative) 估计优势:

从而移除 critic 模型:

KL 散度惩罚

KL 散度惩罚, 可以防止策略偏离参考模型太远:

kl_coef (KL 散度惩罚系数) 太小 (0.01) 可能导致策略偏离太远 (输出混乱或质量下降),

太大 (0.5) 可能限制学习 (学习缓慢):

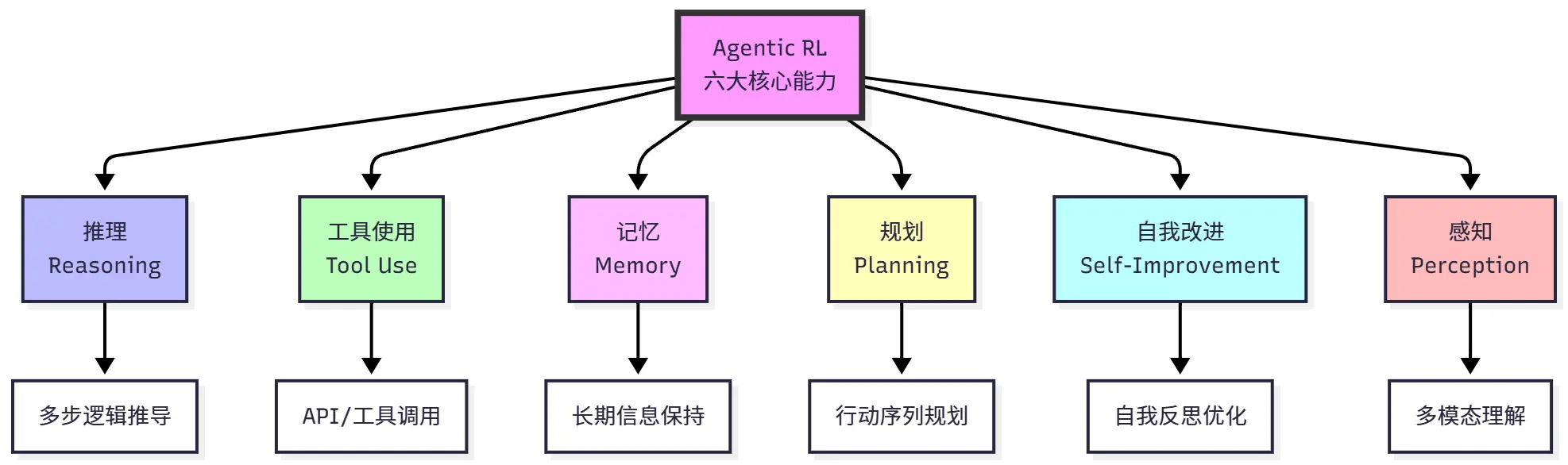

Agentic RL

- Reasoning: 通过试错学习有效的推理策略, 发现训练数据中没有的推理路径

- Tool Use: 学会何时使用工具、选择哪个工具、如何组合多个工具

- Memory: 学会记忆管理策略, 决定哪些信息值得记住、何时更新/删除

- Planning: 学会动态规划, 权衡短期和长期收益, 发现有效的行动序列

- Self-Improvement: 学会自我反思, 识别错误、分析失败原因、调整策略

- Perception: 提升多模态理解能力, 学会视觉推理、使用视觉工具和视觉规划